[IJCAI 2025] Understanding Visual Detail Hallucinations of Large Vision-Language Models

孙晓希的关于视觉细节幻觉评估论文《Understanding Visual Detail Hallucinations of Large Vision-Language Models》被IJCAI 2025接收。

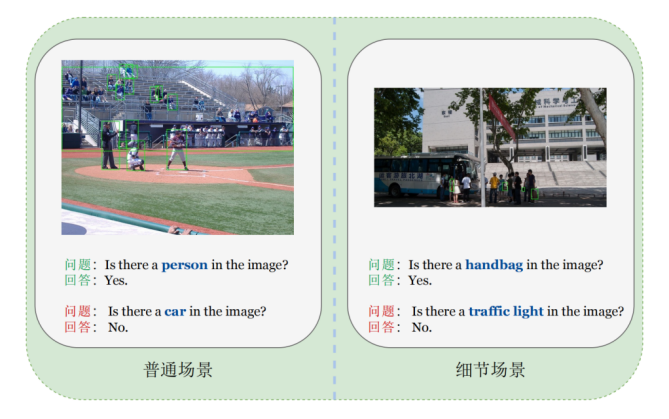

本工作系统性研究了当前大规模视觉语言模型在小目标场景下的细粒度视觉幻觉现象。基于 MSCOCO 构建了一个专门面向“小物体 / 细节”的评测数据集,将场景划分为小物体(detail)与常规物体两类,并从存在、颜色、相对位置三个维度定义视觉细节幻觉,总计设计了 3,500 余条是非问答样本,用于全面刻画 LVLM 在细节上的可靠性。在该数据集上评测了 11 个代表性 LVLM,并进一步分析了三类训练自由方法(Scaffold、CoT、图像放大)的效果,同时对 Eagle-X5 中混合视觉编码器的贡献进行了消融实验。结果表明:相较于常规物体,小物体相关问题的性能显著下降,且“常规场景表现好 ≠ 小物体场景表现好”;混合视觉编码结构在缓解细节幻觉上明显优于单一 ViT 编码器,其中 ConvNeXt 对“存在类”问题尤为关键,而多编码器融合更有利于颜色与位置等复杂细节;对支持任意分辨率的模型,通过图像放大可以显著降低细节幻觉。

王选计算机研究所

王选计算机研究所